MOSS-TTSD是什么

MOSS-TTSD 是由上海创智学院、复旦大学和模思智能的OpenMOSS团队联合推出的一个开源的文本到口语对话生成模型,专为多人对话场景设计,能够将完整的对话脚本直接转换为自然流畅、富有表现力的多说话人语音。与传统TTS系统不同,MOSS-TTSD不是简单地将单句语音拼接起来,而是从整体对话语境出发,建模说话人之间的互动韵律和情感变化,生成具有高度拟人化的对话语音。

该项目基于Qwen3-1.7B-base大型语言模型进行续训练,采用创新的离散化语音序列建模方法,在约100万小时单说话人语音数据和40万小时对话语音数据上进行大规模训练。这种海量数据的训练使得MOSS-TTSD能够精准捕捉对话中的微妙变化,如语气转折、情感起伏和话轮转换,生成的语音自然度已达到与商业解决方案相当的水平。

功能特色与技术创新

自然生动的对话语音生成

MOSS-TTSD最显著的特点是能够生成自然生动的对话语音,而非机械的单句拼接。传统TTS系统在处理对话文本时,通常是将每个说话人的语句单独合成后再组合,导致对话缺乏连贯性和互动感。而MOSS-TTSD基于统一的语义-声学神经音频编解码器和预训练的大型语言模型,能够理解对话的整体语境,生成的语音呈现出真实的对话韵律和情感流动。

在技术实现上,MOSS-TTSD通过两阶段建模策略同时捕捉语音的语义信息和声学特征。第一阶段训练自动语音识别(ASR)任务和重建任务,使编码器能够保留粗粒度的声学信息;第二阶段固定编码器和量化层,专注于解码器的训练,利用生成对抗网络(GAN)补充细粒度的声学细节。这种双阶段方法确保了合成语音既语义准确又声学自然。

中英双语无缝切换

MOSS-TTSD具备强大的双语处理能力,可流畅生成中文和英文对话语音,并能在两种语言间自然切换。这一特性对于全球化应用场景尤为重要,如跨国企业的多语言客服系统、双语教育内容制作等。

双语支持的实现得益于模型训练数据的多样性和特殊的架构设计。团队收集并清洗了大规模的中英文单说话人和对话语音数据,同时采用共享的语义编码空间,使模型能够学习到跨语言的语音表征。在推理阶段,用户只需提供目标语言的对话文本,模型便可自动识别语言类型并生成相应语音,无需额外配置。

零样本音色克隆

"零样本音色克隆"是MOSS-TTSD的另一项突破性功能,它允许模型仅凭短样本音频(通常只需几秒钟)就能克隆目标说话人的音色特征,而无需对该说话人进行额外的模型训练。这意味着用户可以使用自己喜欢的播客主持人、明星甚至亲友的声音来生成个性化语音内容。

这项功能的实现依赖于创新的XY-Tokenizer设计,它能够将说话人的声学特征与语音内容解耦,形成独立的控制维度。在生成过程中,系统会将目标音色的嵌入向量与文本语义向量结合,通过解码器重构出具有目标音色特性的语音波形。实测表明,MOSS-TTSD在音色相似度和克隆准确性上均优于同类开源模型。

长语音生成能力

传统TTS系统由于内存和计算限制,通常只能生成较短语音片段(几十秒内),长内容需要分段合成后再拼接,导致衔接处不自然。MOSS-TTSD通过低比特率编解码器(压缩至1kbps)和优化的训练框架,实现了最长960秒(16分钟)的连续语音生成。

长语音生成的技术关键在于XY-Tokenizer的8层RVQ(Residual Vector Quantization)设计,它将语音信号高效离散化,大幅降低了序列长度和内存占用。同时,团队改进了自回归生成中的Delay Pattern机制,使模型能够更好地保持长程一致性,避免生成过程中的累积误差。这一特性使MOSS-TTSD特别适合播客、有声书、影视配音等长内容生成场景。

开源免费商用

与许多将核心技术闭源的商业TTS产品不同,MOSS-TTSD坚持完全开源的策略,模型权重、推理代码和关键工具全部公开,并采用宽松的Apache 2.0许可证,允许免费商用。这一决策显著降低了语音合成技术的应用门槛,使个人开发者、初创公司乃至大型企业都能无负担地集成MOSS-TTSD到自己的产品中。

开源生态还带来了快速迭代的优势。项目团队提供了完整的工具链支持,包括Podever播客生成管道——一个能够将PDF、URL或长文本自动转换为高质量播客内容的工具,极大地简化了内容创作流程。社区开发者也可以基于开源代码进行二次开发,满足特定场景的定制化需求。

核心技术解析

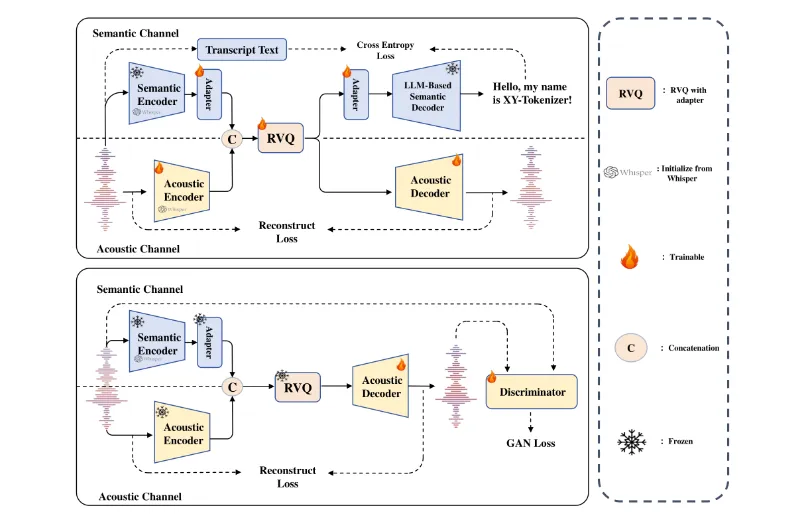

XY-Tokenizer:语音离散化的创新突破

MOSS-TTSD的核心技术创新在于其专有的XY-Tokenizer——一个8层RVQ(残差向量量化)的音频编解码器,能够同时建模并编码语音的语义和声学信息。与传统语音编码器不同,XY-Tokenizer通过双路Whisper编码器分别处理语音信号,一路专注于语义内容提取,另一路捕捉声学特征,然后将两者在量化层前融合,实现多维度信息的高效编码。

这种双通道设计带来了显著的性能提升。一方面,语义通道确保了文本内容的准确传达;另一方面,声学通道保留了丰富的副语言信息,如语调、节奏和情感色彩。通过8层RVQ的逐步量化,XY-Tokenizer将比特率压缩至1kbps,仅为传统语音编码器的1/10~1/20,使得大语言模型能够有效学习音频序列并建模细节声学特征。

训练过程中,XY-Tokenizer采用两阶段多任务学习策略。第一阶段同时训练ASR任务和重建任务,使编码器在准确转录文本的同时保留基本的声学信息;第二阶段固定编码器和量化层,仅训练解码器部分,通过重建损失和GAN损失补充细粒度声学细节。这种分阶段优化策略既保证了语义准确性,又提升了语音的自然度。

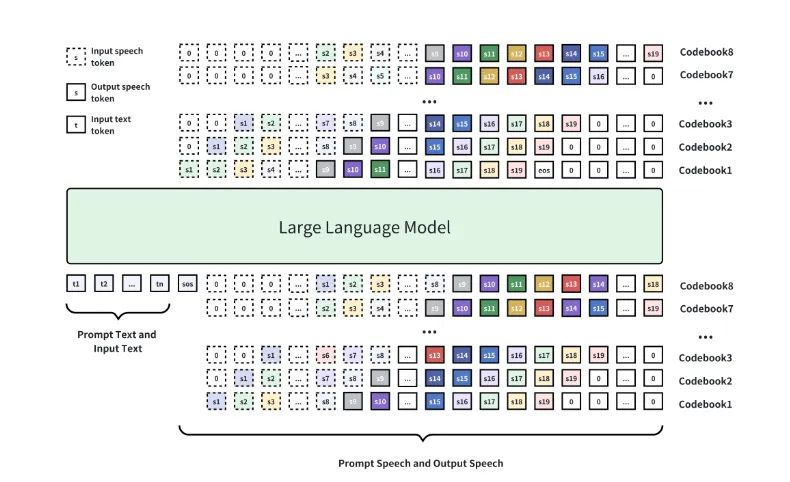

基于Qwen3-1.7B的语音序列建模

MOSS-TTSD选择Qwen3-1.7B-base作为基础模型,这是一个具有17亿参数的大型语言模型,在通用文本理解和生成任务上表现出色。团队对该模型进行了续训练,使其适应语音序列的生成任务。

语音序列建模面临的主要挑战是长程依赖和高时间分辨率。与文本token相比,语音帧的密度高出数十倍(典型语音编解码器每秒生成50-100个token),直接自回归生成极易出现错误累积。MOSS-TTSD创新性地引入Delay Pattern机制,在自回归过程中加入可控的延迟,让模型能够基于更长的上下文进行预测,显著提高了生成稳定性。

另一个关键技术是动态掩码策略。在训练过程中,系统会随机掩码部分语音token,强制模型基于上下文进行补全,这种去噪训练大大增强了模型对不完整输入的鲁棒性。在推理阶段,这一特性使MOSS-TTSD能够处理有噪声或部分缺失的输入文本,生成连贯自然的语音输出。

海量数据处理与质量管控

高质量的数据是优秀TTS模型的基础。MOSS-TTSD团队构建了完整的数据处理流水线,能够从海量原始音频中准确筛选出高质量的单人语音和多人对话数据。流程包括说话人分离、语音质量评估、文本转录和细粒度标注等多个环节。

在说话人分离环节,团队开发了自研模型,其性能超越了开源的pyannote-speaker-diarization-3.1及其商用版本。如表1所示,该模型在多个测试集上的Diarization Error Rate(DER)均优于基线系统:

表1:说话人分离模型性能对比(DER越低越好)

| 模型 | AISHELL-4 | AliMeeting | AMI(IHM) | AMI(SDM) |

|---|---|---|---|---|

| pyannote-speaker-diarization-3.1 | 11.7 | 24.7 | 20.5 | 24.3 |

| pyannoteAI | 11.1 | 18.3 | 17.5 | 20.0 |

| Ours Diarization Model | 9.7 | 14.1 | 14.5 | 17.2 |

对于多人对话语音,团队还训练了专门的对话ASR模型,解决了现有系统无法准确转录重叠语音的问题。所有语音片段都经过DNSMOS质量评分,仅保留分数≥2.8的高质量样本。这种严格的数据筛选确保了训练集的纯净度,为模型优异性能奠定了基础。

应用场景与实践案例

AI播客与有声内容创作

MOSS-TTSD特别适合AI播客制作,能够将文本内容自动转换为富有表现力的对话语音。团队测试表明,使用奇绩"前沿信号研究体系"的每日推文作为内容,MOSS-TTSD生成的播客在情感丰富度、语气自然度和整体表现力上与商业产品豆包相当。

项目提供的Podever工具进一步简化了播客创作流程,支持从PDF、网页URL或纯文本一键生成完整播客,包含多说话人对话、背景音乐和自然过渡。创作者只需准备文本内容,无需专业录音设备或配音演员,即可制作出高质量的音频节目。

智能客服与虚拟助手

在智能客服领域,MOSS-TTSD可以生成更加自然、富有情感的语音回复,显著提升用户体验。传统客服语音往往单调机械,而MOSS-TTSD能够根据对话上下文调整语调、节奏和情感表达,使交互更加人性化。

对于虚拟助手应用,模型的零样本音色克隆功能特别有价值。企业可以使用品牌代言人或特定角色的声音作为语音形象,增强识别度和亲和力。同时,双语支持使同一助手能够服务不同语言用户,降低国际化部署成本。

教育辅助与语言学习

教育领域是MOSS-TTSD的另一重要应用场景。在语言学习中,模型可以提供自然的发音示范和情景对话练习;在在线课程制作中,可以快速生成生动的讲解语音,减少教师录音负担。

特别有价值的是,MOSS-TTSD能够生成特定口音或语速的语音,帮助学习者适应多样化的语言环境。教师还可以创建不同角色的对话内容,使学习过程更加互动有趣。

影视游戏配音与广告制作

对于影视、游戏等娱乐产业,MOSS-TTSD的长语音生成和音色克隆功能可以大幅降低配音成本。制作方可以先用临时语音生成完整对白进行预览,确定后再由专业演员录制,或直接使用克隆音色生成最终版本。

在广告行业,快速生成多种风格、音色的语音广告能够满足不同营销需求。广告商可以针对不同受众群体定制语音特性,如年龄感、方言特色等,提升广告效果。

相关链接

-

GitHub仓库: https://github.com/OpenMOSS/MOSS-TTSD

-

Hugging Face模型页: https://huggingface.co/spaces/fnlp/MOSS-TTSD

-

在线演示: https://www.open-moss.com/cn/moss-ttsd/

系统要求

MOSS-TTSD支持在多种环境中运行,推荐配置如下:

-

Python 3.10+

-

PyTorch 2.0+

-

CUDA 11.7+(GPU运行)

-

内存:至少16GB(生成长语音建议32GB以上)

总结

MOSS-TTSD作为开源的文本到对话语音生成模型,通过创新的XY-Tokenizer设计、百万小时级数据训练和精心优化的系统架构,成功突破了对话语音合成的关键技术瓶颈,实现了自然流畅、富有情感的多说话人语音生成。项目不仅具备零样本音色克隆、中英双语支持和长语音生成等先进特性,还坚持完全开源和免费商用的原则,为语音技术的发展和普及做出了重要贡献。无论是AI播客制作、智能客服、教育辅助还是娱乐媒体创作,MOSS-TTSD都提供了强大而灵活的解决方案,标志着对话语音合成技术迈入了一个新阶段。

王子主页

王子主页